Comprendre le rôle des algorithmes dans la polarisation politique des réseaux sociaux

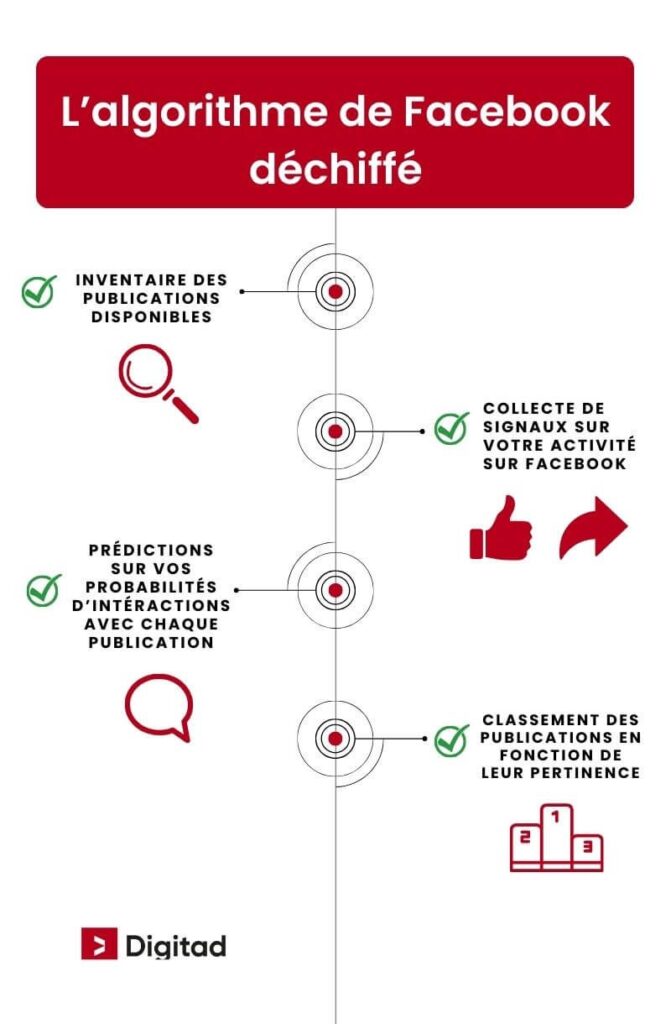

Les algorithmes des réseaux sociaux jouent un rôle central dans la manière dont nous consommons l’information et interagissons en ligne. En 2025, ces systèmes sophistiqués continuent d’être au centre des débats concernant leur influence sur les tensions politiques et la polarisation. Conçus initialement pour maximiser l’engagement des utilisateurs, ils sélectionnent et classent les contenus selon des critères souvent liés à la popularité ou à la réactivité émotionnelle. Il en résulte une exposition accrue aux contenus polarisants qui exacerbent les divisions idéologiques.

Un exemple concret est l’étude menée durant les semaines précédant l’élection présidentielle américaine de 2024. Les chercheurs ont développé une méthode pour modifier en temps réel le classement des publications dans les fils d’actualité, en réduisant la visibilité de celles prônant des attitudes anti-démocratiques ou un discours haineux. Contrairement à la suppression, seule leur position dans le fil est abaissée, ce qui contraint les utilisateurs à plus d’efforts pour les découvrir. Cette démarche a mené à une diminution notable des émotions négatives et d’hostilité partisane chez les participants, quel que soit leur camp politique.

Ces constats font écho à une idée reçue souvent opposée : il faudrait choisir entre des fils 100 % chronologiques, censés être neutres, et des algorithmes basés uniquement sur l’engagement. En réalité, il existe un éventail d’approches à explorer, combinant régulation et optimisation, visant à réduire la désinformation et à faciliter un dialogue apaisé. La question cruciale est désormais de savoir comment ces modifications peuvent être appliquées à grande échelle dans des environnements sociaux numériques diversifiés, en respectant notamment la liberté d’expression.

Par ailleurs, cette expérience met en lumière une nécessité encore peu abordée : il est urgent de définir des cadres permettant à des chercheurs indépendants de tester des variantes algorithmiques en conditions réelles, afin d’évaluer les impacts sociaux et politiques. Un tel contrôle scientifique des algorithmes ouvrirait la voie à des environnements numériques plus sûrs et moins propices à la radicalisation ou aux discours polarisants.

Les défis de la modération algorithmique ne se limitent pas à la politique. La propagation de la désinformation sur la santé, l’incitation à la haine ou encore la manipulation des émotions via des contenus viraux soulignent l’ampleur du rôle de ces dispositifs techniques, souvent opaques pour l’utilisateur lambda. Pour s’en prémunir, les régulations nationales et internationales doivent s’adapter en priorité au fonctionnement de ces algorithmes, une thématique qui fait l’objet d’analyses fines et parfois controversées.

L’expérience des chercheurs : une réorganisation intelligente des fils d’actualité pour un apaisement politique

La recherche mentionnée plus haut a été pionnière en permettant, via un outil web open source, de réorganiser en temps réel les fils d’actualité de participants volontaires sur la plateforme X, anciennement Twitter. L’approche retenue ne visait pas à censurer ou supprimer les contenus polarisants ; il s’agissait de les reléguer plus bas dans le scrolling, limitant ainsi leur impact immédiat sur l’humeur et le jugement des utilisateurs.

Les résultats ont été probants : en réduisant la visibilité des messages violents ou appelant à la division, les participants ont manifesté une meilleure perception des opposants politiques et une baisse d’agressivité dans leurs réactions. Ce phénomène est particulièrement important dans un contexte marqué par des épisodes répétitifs de discours haineux et de « rage bait » — une technique utilisée pour provoquer des réactions outrées et collecter plus d’engagement. Les algorithmes, en favorisant ces types de contenus, créaient un cercle vicieux de polarisation et d’hostilité.

Cette expérience illustre aussi le potentiel des grands modèles de langage (LLM) dans la modération et le classement des contenus. Utilisés pour identifier précisément les messages qui polarisent, ces outils offrent aux plateformes des moyens techniques inédits pour moduler leurs fils d’actualité de façon plus responsable. Par ailleurs, ils permettent d’envisager de nouveaux systèmes où l’utilisateur pourrait choisir les principes qui régissent ce qu’il voit, favorisant une personnalisation respectueuse de ses valeurs sans encourager la radicalisation.

Les pistes explorées intègrent notamment des modèles favorisant un dialogue moins conflictuel, sur des plateformes concurrentes comme Bluesky, qui développent des alternatives pour réorganiser l’ordre des publications dans un sens prosocial. Ces évolutions reflètent une prise de conscience collective que la censure excessive et les régulations trop lourdes ne sont pas les seules réponses à la tempête des interactions en ligne.

Dans le même esprit, certaines expérimentations universitaires, comme celles menées en partenariat avec Meta, montrent qu’un simple retour aux fils chronologiques ne suffit pas à réduire la polarisation. La subtilité repose donc sur l’approche algorithmique, combinant plusieurs facteurs tels que la nature des messages, leur potentiel de violences émotionnelles et les dynamiques relationnelles entre utilisateurs.

Les défis éthiques et politiques autour de la modification des algorithmes

Modifier les algorithmes pour apaiser les tensions politiques implique une série de questions à la croisée de l’éthique, de la liberté d’expression et de la régulation des contenus. Le problème est loin d’être simple : où placer la limite entre un algorithme bienveillant et un système de censure ? Comment préserver la pluralité d’opinions tout en combattant la désinformation, la radicalisation et les discours haineux ? Ces interrogations occupent désormais une place centrale dans les discussions politiques et académiques.

Les plateformes de réseaux sociaux sont sous la pression constante des gouvernements et des citoyens pour renforcer la modération. Cependant, l’automatisation accrue basée sur les algorithmes soulève des inquiétudes, notamment sur la transparence et le contrôle exercé par des entités privées. Certains pays, à l’instar de la Chine, ont pris des mesures radicales en contrôlant étroitement leurs réseaux sociaux, ce qui alimente le débat sur les conséquences d’une régulation étatique trop poussée, quitte à restreindre des libertés fondamentales.

En Europe et ailleurs, les régulateurs cherchent donc des solutions intermédiaires. Par exemple, l’ARCOM (Autorité de régulation de la communication audiovisuelle et numérique) œuvre pour sensibiliser les jeunes générations à un usage critique et responsable des médias sociaux. Ces initiatives visent à conjuguer régulation technique et éducation aux médias, afin d’atténuer les effets toxiques comme ceux liés à la désinformation sur la santé ou à la radicalisation des mineurs.

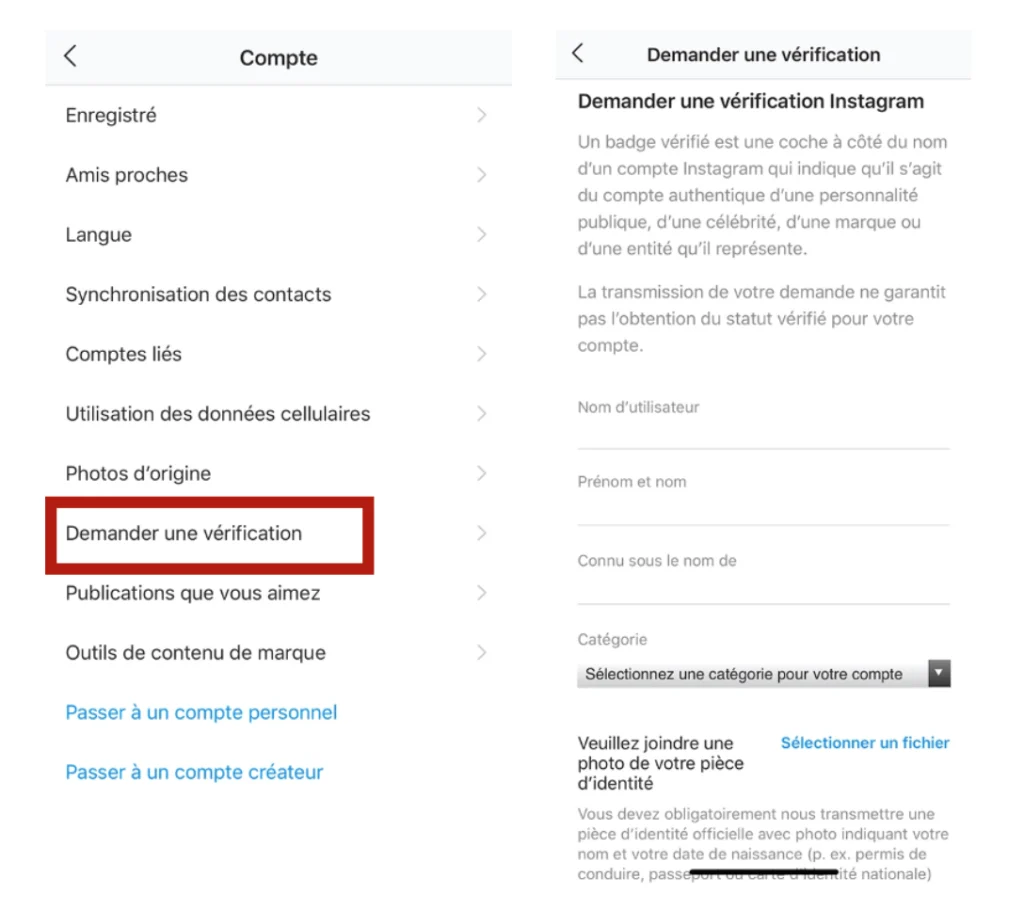

Les entreprises elles-mêmes expérimentent désormais des systèmes donnant des outils supplémentaires aux utilisateurs pour gérer leur expérience : possibilité de filtrer certains contenus, d’opter pour un classement différent des publications ou de privilégier des formats moins polarisants. Cette responsabilisation des utilisateurs ne se fait pas au détriment du contrôle politique, mais en partenariat avec un cadre réglementaire évolutif.

Face à ces enjeux, un paradigme émerge où la régulation ne serait pas uniquement répressive, mais aussi proactive, cherchant à créer des interactions plus harmonieuses en ligne, adaptées à des contextes culturels variés. Le succès de ces initiatives dépendra néanmoins d’une collaboration étroite entre chercheurs, plateformes, autorités et utilisateurs eux-mêmes.

Les effets concrets des modifications algorithmiques sur le bien-être des utilisateurs

Au-delà de la dimension politique, la manière dont les algorithmes façonnent l’expérience utilisateur a des conséquences directes sur la santé mentale et le bien-être social. En limitant la visibilité des contenus agressifs ou polarisants, les expériences récentes montrent une réduction du stress, de l’anxiété et des émotions négatives qui se propagent souvent sur les réseaux sociaux.

Par exemple, de nombreux jeunes utilisateurs rapportent un mal-être lié à l’exposition répétée à des discours toxiques ou à la comparaison sociale exacerbée par des fils d’actualité manipulés pour optimiser l’engagement. Ainsi, des initiatives visant à limiter le scrolling infini ou à réduire la promotion de contenus sensationnalistes contribuent à améliorer le ressenti général et la satisfaction des utilisateurs.

Les plateformes sont donc incitées à intégrer des objectifs mixtes dans leurs algorithmes : allier engagement et respect du bien-être. Cela peut se traduire par un équilibre subtil entre contenu informatif, divertissant et non conflictuel. En parallèle, des fonctions comme le contrôle parental renforcé ou la détection précoce de signaux liés au mal-être, tels que le risque de suicide, deviennent des outils cruciaux pour soutenir la jeunesse en ligne.

L’ensemble de ces mesures va bien au-delà du simple réglage technique : il s’agit d’une transformation de la culture numérique dans laquelle la place accordée à la modération et à la régulation des algorithmes joue un rôle fondamental. D’ailleurs, des publications récentes insistent sur le fait qu’un dialogue continu et ouvert entre spécialistes, pouvoirs publics et internautes est indispensable pour accompagner ces évolutions.

Ces avancées doivent s’accompagner d’une vigilance accrue sur le risque de dérives, par exemple la censure ciblée comme cela a pu être observé à l’encontre de certains mouvements politiques, qu’ils soient progressistes ou d’extrême droite. La transparence sur les critères utilisés et la capacité des utilisateurs à comprendre et influencer le fonctionnement des algorithmes restent des priorités pour rendre ces technologies plus justes et respectueuses des droits fondamentaux.

Vers une régulation dynamique des algorithmes pour un dialogue apaisé en ligne

La modification des algorithmes des réseaux sociaux n’est pas une fin en soi, mais un levier parmi d’autres pour calmer les tensions politiques et restaurer un climat de dialogue constructif. En 2025, les avancées techniques et scientifiques offrent des pistes innovantes pour transformer progressivement ces environnements numériques souvent perçus comme des champs de bataille idéologiques.

Une régulation dynamique, capable d’intégrer les spécificités culturelles, les valeurs personnelles et les besoins des utilisateurs, semble désormais envisageable. Des bibliothèques de valeurs pluralistes, comme Alexandria, ou des systèmes de réorganisation du fil d’actualité basés sur des principes prosociaux ouvrent des perspectives inédites, laissant l’utilisateur plus maître de son expérience sans sacrifier le pluralisme.

Ces propositions rejoignent une tendance nouvelle où la co-construction des espaces numériques devient une priorité. Cela demande aussi que les législateurs élaborent des lois adaptées, favorisant à la fois la liberté d’expression et la lutte contre la désinformation et les discours haineux. Par exemple, la récente multiplication des débats sur les réseaux sociaux en France et ailleurs porte souvent sur des mesures légales encadrant la transparence et la responsabilité algorithmique.

Dans ce contexte, les exemples internationaux révèlent des stratégies très diverses, allant de l’autorégulation des plateformes à des législations strictes. Ces approches influencent directement la qualité du dialogue démocratique et la capacité des citoyens à s’informer sereinement, sans être piégés dans des bulles de filtre qui alimentent la polarisation.

Enfin, il est important de souligner que modifier les algorithmes ne peut remplacer une prise de conscience collective et l’éducation aux médias. La jeunesse particulièrement, très présente sur les réseaux, doit être outillée pour repérer la désinformation, comprendre le fonctionnement des systèmes numériques et s’exprimer dans un cadre respectueux. Cette équation complexe engage chercheurs, éducateurs, décideurs et entreprises à bâtir ensemble un avenir numérique moins conflictuel et plus démocratique.

modifier les algorithmes des réseaux sociaux est donc plus qu’une question technique : c’est un enjeu sociétal majeur pour la cohésion politique et sociale. Des ressources complémentaires sur les désinformations sur les réseaux sociaux et la censure des contenus polarisants sont essentielles pour mieux comprendre ce défi. Par ailleurs, les algorithmes et la polarisation politique constituent un domaine d’étude crucial pour esquisser les futurs des plateformes sociales. Enfin, la question du cadre juridique encadrant les réseaux sociaux reste au cœur des débats pour garantir un espace de dialogue sain et équilibré.