Comment les algorithmes des réseaux sociaux nourrissent la polarisation politique

Depuis l’avènement des réseaux sociaux, nos interactions en ligne sont en grande partie régies par des algorithmes. Ces formules mathématiques sophistiquées sélectionnent, filtrent et hiérarchisent les contenus que nous voyons sur nos fils d’actualité. Initialement conçues pour capter notre attention et maximiser notre temps passé sur les plateformes, elles ont toutefois des conséquences profondes sur la dynamique politique et sociale.

Ces algorithmes tendent à mettre en avant des contenus à fort potentiel émotionnel et engageant, souvent sous forme d’articles polarisants, de discours virulents ou de controverses marquées. Cette logique de classement peut accentuer la division entre groupes politiques et encourager les tensions idéologiques. Par exemple, un utilisateur engagé dans un débat politique va voir son fil d’actualité rempli de publications qui renforcent ses convictions, excluant ainsi le dialogue constructif avec ceux d’opinions contraires. Ces effets contribuent à une perception biaisée de la réalité, créant des bulles informationnelles où règnent la désinformation et la méfiance.

Des études récentes montrent à quel point ces processus augmentent la polarisation en alimentant la rage et le désaccord. L’enjeu est d’autant plus crucial que cette dynamique s’inscrit dans un contexte historique où les déclarations publiques et médiatiques sont de plus en plus sujettes à la manipulation émotionnelle. Ainsi, les algorithmes ne sont pas neutres mais influencent réellement la santé du débat démocratique.

Malheureusement, cette situation ne facilite pas l’insertion des jeunes générations dans un dialogue politique apaisé. Certains jeunes développent un esprit critique, mais d’autres, exposés à des contenus nocifs, peuvent s’enfermer dans des radicalités, découvrant ainsi la radicalisation sur les réseaux sociaux. La question n’est donc plus seulement technologique, elle devient sociale, impliquant une responsabilité collective et notamment celle des plateformes et des législateurs pour réguler ces espaces.

L’importance croissante des réseaux sociaux dans la formation de l’opinion publique s’allie à un défi technologique : comment modifier ces algorithmes pour qu’ils incitent à une interaction en ligne plus sereine sans tomber dans la censure ?

Les méthodes innovantes pour modifier les fils d’actualité et diminuer les tensions

Récemment, des chercheurs en informatique sociale ont développé des méthodes techniques inédites pour ajuster en temps réel le classement des contenus visibles dans les fils d’actualité. Ces modifications ne suppriment pas les messages polarisants, mais les relèguent à des positions moins visibles, obligeant les utilisateurs à faire plus d’efforts pour y accéder.

Cette démarche repose notamment sur l’utilisation de modèles de langage avancés (LLM) capables d’identifier les publications exprimant des attitudes anti-démocratiques ou de l’hostilité partisane, comme des appels à la violence politique ou à la répression de membres d’un parti opposé. Grâce à cette détection fine, les contenus susceptibles d’exacerber les tensions sont abaissés dans le flux, réduisant notablement leur impact émotionnel.

Une expérience pionnière menée lors des semaines précédant l’élection présidentielle américaine a validé cette approche. Sur dix jours, les participants consentants ont vu leurs fils redirigés vers des posts moins polarisants. Il en résulte une amélioration significative de leur perception des opposants politiques et une diminution des émotions négatives, quel que soit leur alignement partisan.

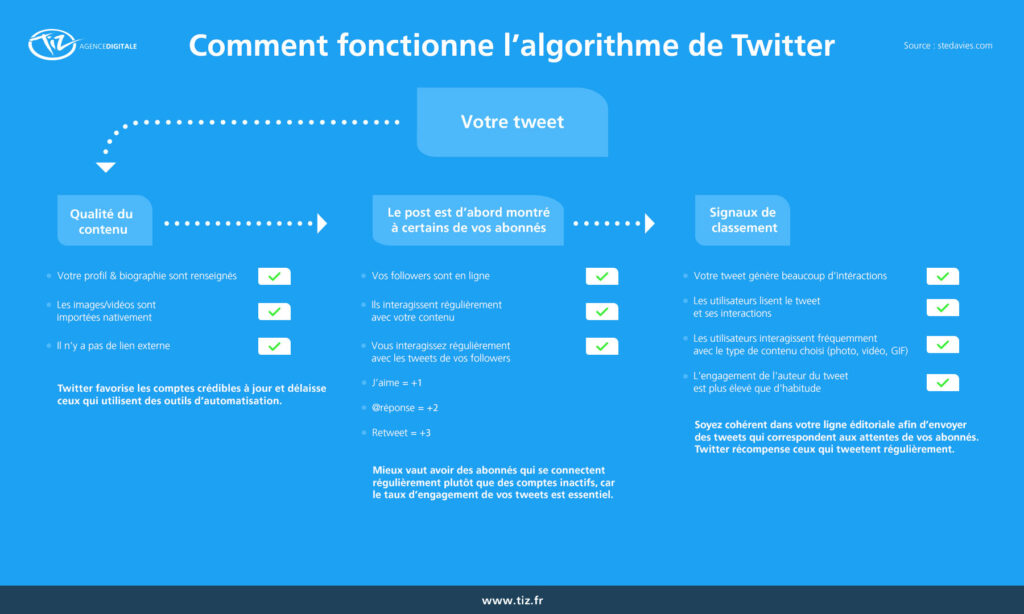

Une telle innovation, possible uniquement parce que des chercheurs ont créé un outil open source pour modifier l’interaction avec la plateforme X (anciennement Twitter), ouvre un champ prometteur pour de futures régulations. On n’est plus dans une logique d’algorithme strictement basé sur le temps ou l’engagement, mais dans une adaptation consciente visant à apaiser le débat.

En offrant cette nouvelle latitude technique, les recherches permettent aussi d’anticiper et d’éviter les discours polarisants et la désinformation qui injectent du poison dans nos échanges numériques. De quoi alimenter positivement les réflexions sur la désinformation sur les réseaux sociaux et la façon dont elle peut être mieux contrôlée.

Le rôle des algorithmes dans la régulation des contenus et la controverse sur la censure

La modification des algorithmes pour calmer les tensions politiques soulève inévitablement des questions sensibles autour de la censure et de la liberté d’expression. Réguler les contenus nocifs sans tomber dans une suppression massive est un équilibre à trouver, d’autant plus que la notion même de ce qui est polarisant peut varier selon le contexte culturel et politique.

Certaines voix dénoncent déjà ce qu’elles considèrent comme une forme de censure déguisée, craignant que les plateformes ne favorisent des biais idéologiques en cachant certains contenus. En particulier, les discours dits progressistes ou d’extrême droite sont souvent surveillés de près, provoquant une controverse qui divise les acteurs du numérique. Ces débats sont illustrés dans plusieurs enquêtes sur la censure des réseaux liée à l’extrême droite ou les efforts pour réguler les contenus sur des bases éthiques et juridiques.

Le défi consiste donc à mettre en place des algorithmes transparents, audités par des chercheurs indépendants, avec des règles claires pour éviter les dérives. Cette innovation technique doit être couplée à une sensibilisation des utilisateurs, surtout les jeunes, pour développer un usage réfléchi et critique des réseaux sociaux.

Il est ainsi essentiel que les plateformes travaillent conjointement avec des instances publiques et des associations afin d’établir une régulation équilibrée. Cela demande non seulement de réfléchir aux critères de visibilité et de classement mais aussi d’accompagner les utilisateurs à mieux comprendre les mécanismes qui influencent leur expérience, comme montré dans plusieurs initiatives pour la vulgarisation des réseaux sociaux.

Les initiatives et recherches en cours pour repenser les interactions en ligne

Les recherches sur l’impact des algorithmes alternatifs ne cessent de croître. En collaboration avec des géants du secteur comme Meta ou au sein de projets universitaires, plusieurs expériences testent des fils d’actualité chronologiques ou hybrides, montrant que la simple suppression des algorithmes de classement ne suffit pas forcément à réduire la polarisation.

Un exemple particulièrement prometteur est le Prosocial Ranking Challenge, piloté par l’Université de Californie à Berkeley. Cette initiative explore comment différents critères de classement peuvent favoriser des interactions sociales plus positives, en valorisant par exemple les contenus prosociaux plutôt que les messages haineux. Cela invite à repenser le design même des réseaux sociaux en intégrant davantage la dimension humaine.

D’autres travaux exploitent les capacités avancées des modèles de langage pour permettre aux utilisateurs de personnaliser leur expérience. Des outils comme Alexandria proposent une bibliothèque de valeurs pluralistes pour guider ce qu’on souhaite voir, permettant à chacun de choisir un fil d’actualité plus en accord avec ses principes. Cette autonomie nouvelle pourrait contrecarrer les effets négatifs de la polarisation tout en limitant la tentation de la surveillance intrusive.

Les plateformes elles-mêmes intègrent ce tournant. Par exemple, Bluesky et X se dirigent vers des modèles plus flexibles où la hiérarchisation des contenus s’adapte mieux aux attentes des utilisateurs et aux impératifs démocratiques. Cette évolution promet de créer des espaces propices à des débats moins acrimonieux, malgré les défis techniques et éthiques nombreux.

Ces avancées sont cruciales pour construire un avenir numérique où les réseaux représentent un véritable outil d’échange réfléchi et non un foyer de tensions exacerbées.

Les perspectives futures pour un équilibre entre régulation et liberté d’expression

À l’horizon, la modification des algorithmes apparaît comme un levier prometteur mais encore partiellement exploré. Au-delà des expérimentations initiales, il est nécessaire d’en approfondir les effets à long terme et d’élargir les objectifs à d’autres enjeux tels que la santé mentale, la satisfaction des utilisateurs et la qualité des échanges sociaux.

Ce travail soulève aussi la question du contexte culturel et des valeurs personnelles. Comment préserver une diversité d’opinions tout en limitant la propagation des discours haineux ou anti-démocratiques ? L’utilisateur pourrait avoir un rôle central dans cette régulation, grâce à des options personnalisées concernant les critères de filtrage. Cette approche responsabilise l’internaute tout en le protégeant des effets délétères.

La double ambition de modérer l’impact social des réseaux sociaux tout en évitant la censure totale incite à redéfinir la gouvernance numérique. Cette nouvelle étape implique non seulement les plateformes et les chercheurs mais aussi des instances réglementaires et la société civile. En France, par exemple, les débats autour de la législation sur les réseaux sociaux et la loi illustrent ces dynamiques complexes.

Enfin, la prise de conscience collective autour de ces questions, aussi bien chez les jeunes que chez les adultes, encourage une déconnexion raisonnée, une meilleure gestion des temps passés en ligne, et la mise en place d’une sécurité renforcée notamment pour les mineurs. Ces pistes combinées amorcent une transformation importante, indispensable pour que les algorithmes cessent d’être des instruments de division et deviennent des facilitateurs de dialogue démocratique sain.